Для чего нужна видеопамять в видеокарте

Графическая память в видеокарте: что это такое и как использовать всю?

Привет, друзья! В публикации «Из чего состоит современная видеокарта для ПК» я вкратце упомянул о функциональном назначении всех компонентов этого девайса. Сегодня разберемся что такое графическая память видеокарты и зачем она нужна?

Что такое видеопамять

Вероятно, вы знаете, что за рендеринг любого изображения в компьютере отвечает графический чип – например, он просчитывает взаимодействие объектов в игре.

Промежуточные данные, которые затем выводятся на монитор, хранятся как раз в видеопамяти. Связаны эти блоки между собой, шиной данных (подробнее о том, что это такое, ее разрядности и влиянии на работу устройства, вы можете почитать здесь).

В современных графических ускорителях сейчас используется память GDDR5 (за исключением бюджетных моделей, некоторые из которых все еще работают на DDR3). По сути, это обычная оперативная память, которая есть в любом ПК.

Но в отличие от оперативки, плата видеопамяти впаяна наглухо, поэтому заменить ее, не раскурочив видеокарту, нет совершенно никакой возможности).

Зачем реализовано такое решение? Не в целях «защиты от дурака», как, вероятно, вы могли подумать. Сделано это для того, чтобы пользователь, которому уже не хватает видеопамяти для запуска какой-нибудь новинки игропрома, не докупил по дешевке дополнительный модуль памяти, а покупал новую навороченную видеокарту.

Хотя, если вы не верите в теорию заговора, можете проигнорировать мое мнение.

Больше – лучше, или нет?

Предметом сравнительной фаллометрии рядовых юзеров часто выступает объем видеопамяти. Случилось это с подачи маркетологов – втюхивая новый продукт, они прожужжат вам все уши по этому поводу.

Почему так? Не так важно, сколько данных может запомнить видеокарта – если она работает медленно, даже разгон не всегда поможет существенно увеличить производительность в играх.

Сколько нужно видеопамяти

Не буду углубляться, как сильно изменились видеоигры за последние 5 лет – если вы «в теме», то и сами все прекрасно видите. Такое качество графики требует мощной видеокарты – если вы, конечно, хотите играть на приемлемых настройках, при этом не страдая от «слайдшоу» во время просадки FPS.

Однако качество графики – не единственная проблема, с которой сталкиваются современные геймеры. В игропроме хорошим тоном стало делать игры с открытым бесшовным миром (если жанр подразумевает такую «фичу» — например, РПГ или шутер).

Игра, в которой пользователю придется постоянно ждать загрузки локаций, имеет высокий шанс стать провальной.

Чтобы запомнить все (или хотя бы ближайшие) объекты такого игрового мира, требуется солидный объем видеопамяти. Для современных игр нормой стал показатель от 3 Гб.

Не хочу вас расстраивать, но это только сегодня пока так – уже через пару лет топовые видеокарты может и не будут тянуть новинки на ультра-настройках. А вы как думали?

Увы, большинство разработчиков нацелены на массового потребителя, поэтому акцент они делают на YOBA-играх, где в угоду «графонию» можно пожертвовать остальными составляющими – сюжетом, продуманным ЛОРом, необычными квестами, которые отличаются от привычных «убить всех».

Какие выводы мы можем сделать

Чуть не забыл, не нужно размышлять, как использовать всю видеопамять – в играх она задействуется автоматически, даже если система отображает, что доступно меньше.

А в качестве возможной покупки, могу порекомендовать MSI GeForce GTX 1060 GAMING X 6G – доступный по цене девайс с объемом видеопямяти 6 Гб и очень неплохими прочими характеристиками. Также советую почитать статью «Выбираем процессор для игрового системного блока».

А на этом у меня все. До следующих встреч на страницах моего блога. Не забываем подписываться на новостную рассылку и делиться публикациями в социальных сетях!

С уважением к вам, автор блога Андреев Андрей.

Видеопамять компьютера и объём памяти видеокарты VRAM

Если открыть форум какой-нибудь популярной компьютерной игры, то обязательно в нём найдётся тема про видеокарты, где на нескольких десятках страниц, помимо прочего, будет активно обсуждаться и объём памяти видеокарты. Продвинутые пользователи могут вступить в активное обсуждение вопроса, а вот для новичка это сплошная тарабарщина. В сегодняшнем посте я хочу немного рассказать что такое видеопамять компьютера и для чего она используется.

Что такое графическая видеопамять компьютера?

Думаю Вам уже понятно, что кроме основной оперативной памяти RAM у компьютера или ноутбука есть ещё и видеопамять — VRAM. Аббревиатура расшифровывается как Video Random Access Memory. Графическая видеопамять видеокарты компьютера — это особый вид оперативной памяти, который используется в дискретных видеоадаптерах компьютеров и ноутбуков. Выполнена она в виде чипов, распаянных на плате видеокарты вокруг графического процессора.

Думаю понятно, что чем больше модулей распаяно, тем больше объём видеопамяти. Тут возникает логичный вопрос — а зачем она нужна, ведь у компьютера и так есть оперативная память!

Память видеокарты используется для временного хранения графических данных — а именно изображения (так называемый буфер кадра ) — сформированных и передаваемых видеоадаптером на монитор ПК. Видеопамять является двухпортовой, то есть она может одновременно записывать данные при изменении изображения и в то же самое время считывать её содержимое для прорисовки изображения на экране. Проще говоря, память видеокарты снабжает графический процессор данными, которые необходимы ему для визуализации изображения — так называемого рендеринга. К этим данным относится буфер кадров, карта теней, используемые текстуры, освещение и так далее.

Как узнать объем видеопамяти

Объём видеопамяти видеоадаптера, установленного на Вашем компьютере Вы можете несколькими способами.

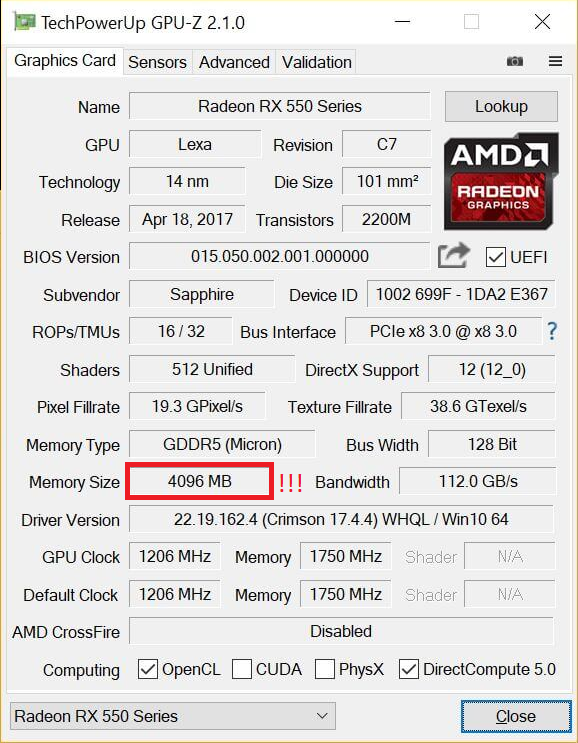

Быстрая, лёгкая и показывает абсолютно всю нужную информацию. В поле Memory Type будет показан тип используемой памяти видеокарты, а в поле Memory Size — её объём.

Как увеличить объем памяти видеокарты

Такой вопрос обычно задают новички. Они знают, что объём ОЗУ у компьютера можно расширить установкой дополнительных модулей и думают, что с видеокартой всё точно так же. А вот и нет, увеличить объём видеопамяти без замены видеокарты не получится. Для этого надо купить новый адаптер и заменить на него старый.

Кстати, у меня в практике был случай, когда один опытный радиотехник загорелся желанием перепаять модули ОЗУ с одной платы на другую. Причём на плате были для этого соответствующие места. Но ничем эта затея не закончилась. Мало того, что подобные работы имеют высокий класс точности, но даже если это и получится сделать физически увеличить объём видеопамяти, нужно будет ещё и перепрошить само устройство. Ведь без соответствующего программного обеспечения плата всё равно не увидит установленные модули ОЗУ.

Сколько памяти нужно видекарте?

Вопрос очень интересный. Тут всё напрямую зависит от того, как будет использоваться видеоадаптер в плане работы с графикой. Например, если это просто офисный компьютер, то ему хватит и встроенного графического адаптера, который будет сам занимать немного видеопамяти из ОЗУ. Если это домашний ПК для фильмов и простеньких игр, то ему вполне хватит от 256 Мб. до 1 Гб. А вот заядлому геймеру или для профессиональной работы с видео нужно будет уже в среднем 2-4 Гигабайта.

Так же необходимо учитывать следующие факторы:

Разрешение монитора

Чем больше у Вас монитор, тем бОльшее он использует разрешение. А чем больше используется разрешение, тем сильнее оно потребляет память видеокарты. Например 1 кадр в качестве FullHD ( разрешение 1920X1080X32) требует 8 Мб видеопамяти. Если же Вы подключили самый современный монитор 4К, то используемое у него разрешение будет потреблять уже в среднем 33 Мб на каждый кадр.

Сглаживание текстур

Сглаживание видео вообще очень сильно потребляет видеопамять. Чем сильнее сглаживание — тем больше потребление VRAM. К тому же разные алгоритмы сглаживания имеют соответственно и разное потребление. Причём разные типы сглаживания по разному потребляют ресурсы компьютера.

Качество текстур и теней

Чем выше качество текстур, чем больше отображается теней у объектов, тем сильнее расходуется и видеопамять компьютера. Это вообще самый сильный потребитель ресурсов видеокарты. Любите поиграть в «тяжелую» игру поставив качество на максимум? Приготовьтесь к тому, что памяти Вашей видеокарты может для этого не хватить. Чем реалистичней качество картинки, тем больше для этого требуется теней и текстур, а значит видеоадаптер будет использоваться по максимуму.

Чем отличаются поколения видеопамяти

Содержание

Содержание

Память, будь то оперативная память или видеопамять, является неотъемлемой частью современного компьютера. Сегодня вкратце узнаем, как все начиналось, как работает, почему диагностические программы показывают неверные частоты, в чем измеряется производительность памяти, как рассчитывается пропускная способность памяти и почему «МГц» для памяти — некорректное выражение.

До 2000-ых годов использовалась оперативная память стандарта SDR.

Потом ей на смену пришел новый стандарт памяти — DDR, который имел удвоенную пропускную способность памяти за счет передачи данных как по восходящим, так и по нисходящим фронтам тактового сигнала. Первоначально память такого типа, как и SDR, применялась в видеоплатах, но позднее появилась поддержка со стороны чипсетов.

DDR (Double Data Rate) расшифровывается как «удвоенная скорость передачи данных».

Таким образом, за один такт передается вдвое больше информации. Увеличилось количество передаваемой информации, реальная частота памяти осталась неизменной. Вместе с этим появилось такие понятия как эффективная частота, которая стала в два раза больше реальной.

Именно с приходом стандарта DDR появилась путаница с реальной и эффективной частотой работы памяти.

Реальная частота — частота шины модуля памяти. Эффективная частота — удвоенная частота шины модуля.

Как можно видеть, реальная частота памяти составляет 1900 МГц, в то время как эффективная в 2 раза больше — 3800 МГц, потому что за один такт теперь поступает вдвое больше данных.

Для того чтобы информация передавалась с удвоенной скоростью, она должна поступать из массива памяти вдвое быстрее. Реализовали это с помощью удвоения внутренней ширины модуля памяти. Благодаря чему за одну команду чтения мы стали получать сразу 2n единицы данных. Для стандарта DDR n = 1. Такая архитектура была названа n-prefetch (предвыборка). У памяти стандарта DDR, одной командой, при чтении, передается от ядра к буферу ввода-вывода две единицы данных.

Вместе с ростом производительности уменьшилось рабочее напряжение с 3.3V у SDR до 2.5V у DDR. Это позволило снизить энергопотребление и температуру, что дало возможность повысить рабочие частоты. На самом деле, потребление и, как следствие, нагрев, — это одна из самых больших проблем оперативной памяти того времени. При полном чтении всего модуля объемом 2 Гбайта память потребляет до 25 Ватт.

Оперативная память стандарта DDR2 пришла на смену стандарту DDR в 2003 году, правда, поддерживающие ее чипсеты появились годом позже. Основное отличие DDR2 от DDR заключается в увеличенной вдвое частоте работы внутренней шины, по которой данные поступают в буфер «ввод-вывод». Передача на внутреннюю шину теперь осуществляется по технологии (4n-Prefetch), одной командой из массива памяти к буферу поступает 4 единицы данных.

Таким способом удалось поднять пропускную способность в два раза, не увеличивая частоту работы чипов памяти. Это выгодно с точки зрения энергоэффективности, да и количество годных чипов, способных работать на меньшей частоте, всегда больше. Однако у данного способа увеличения производительности есть и минусы: при одинаковой частоте работы DDR2 и DDR временные задержки у DDR2 будут значительно выше, компенсировать которые можно только на более высоких частотах работы.

Рабочее напряжение понизилось почти на 30% до 1.8V.

На основе стандарта DDR для видеокарт в 2000 году был разработан новый стандарт памяти GDDR.

Технически GDDR и DDR похожи, только GDDR разработан для видеокарт и предназначен для передачи очень больших объемов данных.

GDDR (Graphics Double Data Rate) расшифровывается как двойная скорость передачи графических данных.

Несмотря на то, что они используются в разных устройствах, принципы работы и технологии для них очень похожи.

Главным отличием GDDR от DDR является более высокая пропускная способность, а также другие требования к рабочему напряжению.

Разработкой стандарта видеопамяти GDDR2 занималась компания NVIDIA. Впервые она была опробована на видеокарте GeForce FX 5800 Ultra.

GDDR2 это что-то среднее между DDR и DDR2. Память GDDR2 работает при напряжении 2.5V, как и DDR, однако обладает более высокими частотами, что вызывает достаточно сильный нагрев. Это и стало настоящей проблемой GDDR2. Долго данный стандарт на рынке не задержался.

Буквально чуть позже компания ATI представила GDDR3, в которой использовались все наработки DDR2. В GDDR3, как и DDR2, реализована технология 4n-Prefetch при операции записи данных. Память работала при напряжении 2V, что позволило решить проблему перегрева, и обладала примерно на 50% большей пропускной способностью, чем GDDR2. Несмотря на то, что разработкой стандарта занималась ATI, впервые его применила NVIDIA на обновленной видеокарте GeForce FX 5700 Ultra. Это дало возможность уменьшить общее энергопотребление видеокарты примерно на 15% по сравнению с GeForce FX 5700 Ultra с использованием памяти GDDR2.

Современные типы видеопамяти

На сегодняшний день наиболее распространенными типами видеопамяти являются GDDR5 и GDDR6, однако до сих пор в бюджетных решениях можно встретить память типа GDDR3-GDDR4 и даже DDR3.

GDDR3

GDDR4

Стандарт GDDR5 появился в 2008 году и пришел на смену стандарту GDDR4, который просуществовал совсем недолго, так и не получив широкое распространение вследствие не лучшего соотношения цена/производительность.

GDDR5 спроектирована с использованием наработок памяти DDR3, в ней используется 8-битовый Prefetch. Учитывая архитектурные особенности (используются две тактовые частоты CK и WCK), эффективная частота теперь в четыре раза выше реальной, а не в два, как было раньше. Таким способом удалось повысить эффективную частоту до 8 ГГц, а вместе с ней и пропускную способность в два раза. Рабочее напряжение составило 1.5V.

GDDR5X — улучшенная версия GDDR5, которая обеспечивает на 50% большую скорость передачи данных. Это было достигнуто за счет использования более высокой предварительной выборки. В отличие от GDDR5, GDDR5X использует архитектуру 16n Prefetch.

GDDR5X способна функционировать на эффективной частоте до 11 ГГц. Данная память использовалась только для топовых решений NVIDIA 10 серии GTX1080 и GTX1080Ti.

Память стандарт GDDR6 появился в 2018 году. GDDR6, как и GDDR5X, имеет архитектуру 16n Prefetch, но она разделена на два канала. Хотя это не улучшает скорость передачи данных по сравнению GDDR5X, оно позволяет обеспечить большую универсальность.

Сейчас данная память активно используется обоими производителями видеокарт в новой линейке NVIDIA серий GeForce 20 и 16 (кроме некоторых решений: GTX 1660 и GTX 1650, так как в них используется память GDDR5). При покупке нужно внимательно изучить характеристики видеокарты, потому как разница в производительности от типа памяти в данном случаи достигает от 5 до 15%. В то время как разница в цене совершенно несущественна.

GDDR5

GDDR6

Также тип памяти GDDR6 активно используется компанией AMD в видеокартах RX 5000 серии.

На начальном этапе GDDR6 способна функционировать с эффективной частотой 14 ГГц. Это позволяет удвоить пропускную способность относительно GDDR5. В дальнейшем эффективная частота будет увеличена, как это происходило с другими типами памяти.

12 мифов о видеокартах, про которые пора забыть

В предыдущих статьях мы поговорили про мифы о процессорах, оперативной памяти и материнских платах, теперь же перейдем к видеокартам, которые уже давно стали обязательной частью любого компьютера.

Первый миф. Чем больше видеопамяти — тем быстрее видеокарта

Казалось бы, это логично — в более мощные видеокарты ставится больше памяти: так, GTX 1070 с 8 ГБ памяти быстрее, чем GTX 1060 с 6 ГБ, а GTX 1080 Ti с 11 ГБ быстрее GTX 1080 с 8 ГБ. Однако следует понимать, что видеопамять, конечно, важна, но зачастую различное ПО не использует всю имеющуюся у видеокарты память: так, в большинстве случаев GTX 1060 с 3 ГБ медленнее версии с 6 ГБ всего на 5-10%, и разница в основном идет из-за различного числа CUDA-ядер.

Но есть производители видеокарт, которые решили воспользоваться этим мифом в свою пользу: так, например, на рынке можно найти GT 740 с 4 ГБ GDDR5 памяти. Казалось бы — да у GTX 780 Ti, топовой видеокарты того поколения, всего 3 ГБ памяти — то есть GT 740, получается, лучше? Разумеется нет — на тех настройках графики, где используется столько памяти, эта видеокарта выдает слайд-шоу. Ну а если снизить уровень графики для повышения «играбельности», то окажется, что использовано от силы 1-2 ГБ памяти. Причем такие видеокарты встречаются и в текущих линейках — так, у AMD есть RX 550 с теми же 4 ГБ GDDR5 — с учетом того, что видеокарта выступает приблизительно на уровне GT 1030, очевидно, что использовать столько памяти она сможет в очень немногих задачах:

Так что не стоит судить о производительности видеокарты, опираясь только на объем видеопамяти.

Второй миф. Если видеокарте не хватит видеопамяти в игре, то обязательно будут фризы, вылеты и тому подобное

Опять же, это кажется логичным: если видеокарте памяти не хватило, взять ее больше неоткуда — значит, программы корректно работать не смогут. Однако на деле это, разумеется, не так — любая видеокарта имеет доступ к оперативной памяти, которой обычно куда больше, чем видеопамяти. Конечно, ОЗУ в разы медленнее, а время доступа к ней больше — это может вызвать проблемы с плавностью картинки, но только лишь в том случае, если собственной памяти видеокарте не хватает сильно: например, у нее 2-3 ГБ памяти, а игра требует 4-5 ГБ. Но если не хватает нескольких сотен мегабайт, то обычно это проблем не вызывает: GPU умеют динамически использовать доступные им ресурсы, и в ОЗУ они стараются хранить ту информацию, которая нужна редко или не требует мгновенного отклика.

Третий миф. От разгона видеокарты сгорают

При этом различные производители продают разогнанные с завода версии видеокарт. Разумеется, при разгоне видеокарта может повредиться — но только в том случае, если вы измените «физические» параметры, такие как напряжение. Изменение программных параметров, таких как частоты, никак на «железо» не влияет, так что максимум, что вы получите, это вылет видеодрайвера или BSOD от выставления слишком высокой частоты.

Четвертый миф. SLI/Crossfire увеличивают производительность и объем видеопамяти во столько раз, сколько видеокарт подключено

Насчет производительности это, скорее, не миф, а теоретический результат. Увы — на практике, хотя тому же SLI 20 лет, а Nvidia его использует больше 10 лет, в большинстве игр прирост или околонулевой, или вообще отрицательный. Лишь в единичных проектах можно получить прирост хотя бы 20-30% в сравнении с одной видеокартой, что, конечно, смешно, с учетом двукратного увеличения стоимости и серьезных требований к блоку питания. Что касается вычислительных задач, то тут все сложнее: так, профессиональный софт вполне может использовать несколько GPU эффективно, но это уже не домашнее применение.

Что касается видеопамяти, то тут все просто: при использовании DirectX 11 или ниже в видеопамять каждого используемого GPU записывается одинаковая информация, то есть у связки видеокарт будет по сути тот же объем памяти, что и у одиночной карты. А вот в API DirectX 12 есть возможность более эффективно использовать Split Frame Rendering, когда каждая видеокарта готовит свою часть кадра. В таком случае объемы видеопамяти суммируются — пусть и с оговорками.

Пятый миф. Профессиональные видеокарты лучше игровых

Миф идет от того, что профессиональные видеокарты (такие как Nvidia Quadro или AMD FirePro) стоят обычно сильно дороже пользовательских «игровых» видеокарт — а раз дороже, значит лучше. На практике вопрос только в том — в какой области лучше? С физической точки зрения большая часть профессиональных видеокарт имеют тот же GPU и тот же объем памяти, что и обычные игровые видеокарты, а разница идет только из-за других драйверов, которые больше заточены под профессиональное применение:

С учетом того, что эти драйвера под игры никто специально не адаптирует, то профессиональные видеокарты в играх зачастую будут несколько хуже аналогичных по производительности игровых GPU. С другой стороны, если мы будем сравнивать эти же видеокарты в различных CAD-ах или 3ds Max — перевес будет на стороне профессиональной графики, причем зачастую очень существенный. Так что ответ на миф таков: сравнивать эти видеокарты в лоб не имеет смысла, они «играют» и в разных ценовых сегментах, и в разных сценариях использования.

Шестой миф. Если видеокарта не раскрывается процессором — это плохо

Пожалуй, самый популярный миф, который гласит о том, что если видеокарта не занята на 100% — это плохо. С одной стороны, это кажется логичным: нагрузка ниже 100% означает, что видеокарта частично простаивает и вы недополучаете часть производительности. С другой стороны, многие забывают, что нагрузить GPU на 100% можно практически при любом процессоре. Как так? Очень просто: каждый процессор в каждой игре может подготовить для видеокарты лишь определенное количество кадров в секунду, и чем процессор мощнее — тем больше кадров он может подготовить. Соответственно, чтобы видеокарта была занята на 100%, она должна иметь возможность отрисовать меньше кадров в секунду, чем может дать ей процессор. Как это сделать? Да очень просто: поднять разрешение, поставить более высокие настройки графики, включить тяжелое сглаживание — и вуаля, GTX 1080 Ti в 5К на ультра-настройках графики «пыхтит», выдавая 15-20 кадров в секунду, а поставленный ей в пару двухядерный Intel Pentium едва ли нагружен на половину.

Легко можно получить и обратную ситуацию: взять ту же самую GTX 1080 Ti и запустить на ней игру в HD-разрешении с минимальными настройками графики — и тут даже Core i9-9900K не сможет подготовить для ней столько кадров в секунду, чтобы она была занята на 100%.

Так что тут можно сделать два вывода: во-первых, если видеокарта недогружена несильно, а итоговый fps вас устраивает — всегда можно еще немного увеличить настройки графики, чтобы получить 100% нагрузку на видеокарту с лучшей картинкой и при той же производительности. Во-вторых, собирайте сбалансированные сборки, дабы не было такого, что процессор занят на 100%, а fps в игре 20 кадров.

Седьмой миф. Чем уже шина памяти — тем ниже производительность видеокарты

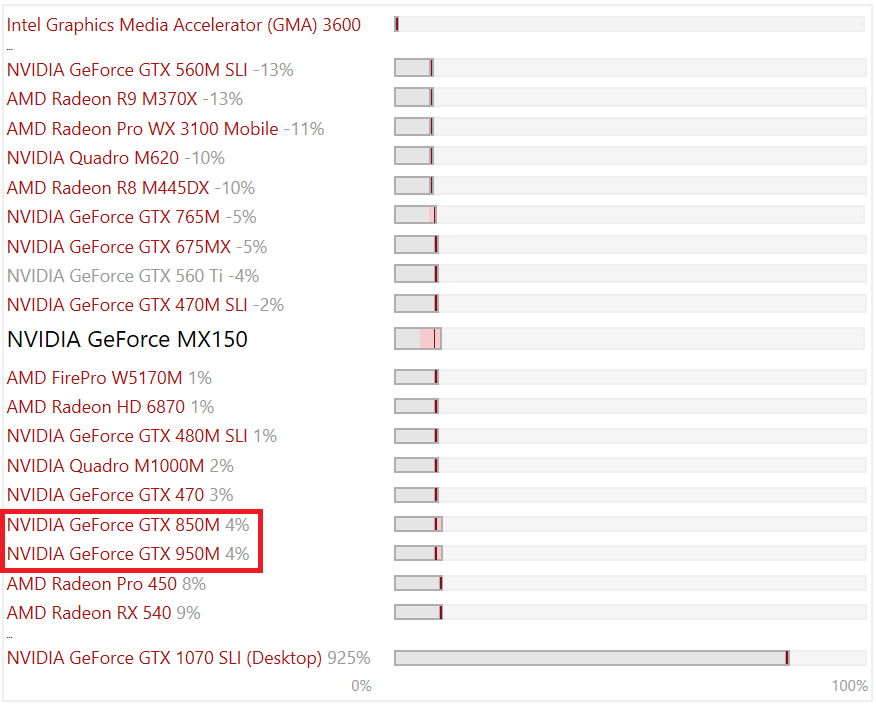

Очень часто на различных форумах можно встретить посты типа «вот, 8 лет назад у GTX 480 шина памяти была 384 бита, а сейчас у GTX 1080 всего 256, Nvidia экономит». Опять кажется, что это логично — чем шире шина, тем больше данных по ней можно «гонять». Но тут следует помнить две вещи: во-первых, не шиной единой: частоты памяти с того времени выросли в разы, во-вторых — производители GPU постоянно улучшают алгоритмы передачи данных по шине, что позволяет использовать ее более эффективно. Все это приводит к тому, что ширину шины можно безболезненно урезать: так, MX150 (она же GT 1030), имея шину всего в 64 бита (как один канал ОЗУ), способна при этом выдавать производительность уровня GTX 950M со 128-битной шиной, которая еще пару-тройку лет назад считалась среднеуровневой мобильной игровой видеокартой:

Восьмой миф. Если видеокарта не перегревается, то она работает на максимально возможной для нее частоте в рамках ее теплопакета

Увы — аналогия с процессорами тут не работает: если те действительно удерживают максимальные частоты в рамках TDP вплоть до температуры, с которой начинается троттлинг из-за перегрева, то видеокарты работают хитрее: так, у Nvidia есть технология GPU Boost, которая, с одной стороны, является аналогом Turbo Boost для процессоров — позволяет поднимать частоту выше базовой — а с другой стороны имеет больше ограничений.

Возьмем, для примера, GTX 1080 Ti. Она имеет родную частоту в 1480 МГц, а Boost — 1580. Но стоит нагрузить видеокарту, как частота может подскочить до 1800-1850 МГц — то есть выше Boost: это и есть работа технологии GPU Boost. Дальше — интереснее: критические температуры у видеокарт поколения Pascal составляют порядка 95 градусов — но уже при 85 можно заметить, что частоты снижаются ближе к уровню Boost. Почему так? Потому что Nvidia ввела еще одну опорную температуру, которую называет целевой: при ее достижении видеокарта старается ее не превышать, а для этого сбрасывает частоты. Так что если у вас мощная видеокарта, да и еще с референсным турбинным охлаждением — внимательно следите за температурами, ибо от них в прямом смысле зависит производительность.

Девятый миф. Видеокарты без дополнительного питания хуже аналогов с ним

В продаже можно встретить видеокарты уровня GTX 1050, 1050 Ti и AMD RX 550 без дополнительного питания — то есть, как в старые добрые времена, достаточно поставить их в слот PCIe и они готовы к работе. При этом также есть версии 1050 и 1050 Ti с дополнительным питанием 6 pin, из-за чего некоторые пользователи делают вывод, что раз дополнительное питание есть — значит с ним видеокарты будут работать лучше.

На деле это не совсем так: слот PCIe способен дать видеокарте до 75 Вт, и этого вполне хватает, чтобы даже 1050 Ti работала на указанных на официальном сайте Nvidia частотах. Но если вы нацелены на разгон — да, тут питания от PCIe видеокарте может уже не хватить, так что дополнительные 6 pin от блока питания позволят достичь больших частот, однако разница в любом случае не превысит 10%.

Десятый миф. Не стоит ставить современные PCIe 3.0 видеокарты на старые платы со слотами PCIe 2.0 или 1.0

Все опять же логично — так, пропускная способность PCIe 2.0 x16 вдвое ниже, чем у 3.0 x16, а, значит, современные видеокарты через более старую шину PCIe будут работать медленнее. На деле это опять же не так — пропускная способность PCI Express 3.0 x16 даже для топовых современных видеокарт оказывается избыточной:

Хорошо видно, что разница между 3.0 x16 и 2.0 x16 составляет всего 1%, то есть погрешность, и даже если спуститься до PCIe 1.1 — то есть к материнским платам почти десятилетней давности — падение производительности оказывается всего лишь 6%. Так что вердикт тут прост — версия PCIe практически не влияет на производительность видеокарты, соответственно можно смело к Xeon с PCI Express 2.0 брать GTX 1080.

Одиннадцатый миф. Разгон видеопамяти не имеет смысла

Конечно, наибольший прирост дает разгон ядра видеокарты — тут прирост производительности близок к линейному (то есть увеличили частоту на 10% — получили прирост производительности на 10%). Однако не стоит сбрасывать со счетов видеопамять, особенно в слабых видеокартах: зачастую в них ставят те же чипы памяти, что и в более мощные решения, но при этом сильно снижают частоту. Это дает возможность ее достаточно сильно разогнать, зачастую на 20-40%, что может прибавить к общей производительности графики еще 10-15% — для слабых видеокарт это лишним, разумеется, не будет:

Двенадцатый миф. С выходом каждой новой линейки видеокарт производители урезают производительность старой

Достаточно популярный миф, основанный обычно на том, что на одних (обычно более старых) версиях драйверов видеокарта работает лучше, чем на других (обычно более новых). Разумеется, никакого реального основания он не имеет: если бы Nvidia и AMD на самом деле хотели заставить пользователей обновить видеокарты, они бы прекращали их поддержку как производители смартфонов на Android, через пару лет после выхода. Однако на деле даже решения 600-ой линейки от Nvidia, вышедшей более 6 лет назад, до сих пор получают новые драйвера наравне с более новыми видеокартами, причем со всеми программными «плюшками» типа DirectX 12.

Но почему тогда есть разница в производительности между драйверами? Потому что ничто в нашем мире не идеально, и какие-то драйвера, улучшая производительность в новых играх, могут испортить производительность в более старых или привести к различным ошибкам. Обычно через некоторые время выходят исправленные драйвера, и все возвращается на круги своя.

Если вы знаете еще какие-либо мифы — делитесь ими в комментариях.